打破藩篱:大模型预训练极限论背后的创新革命

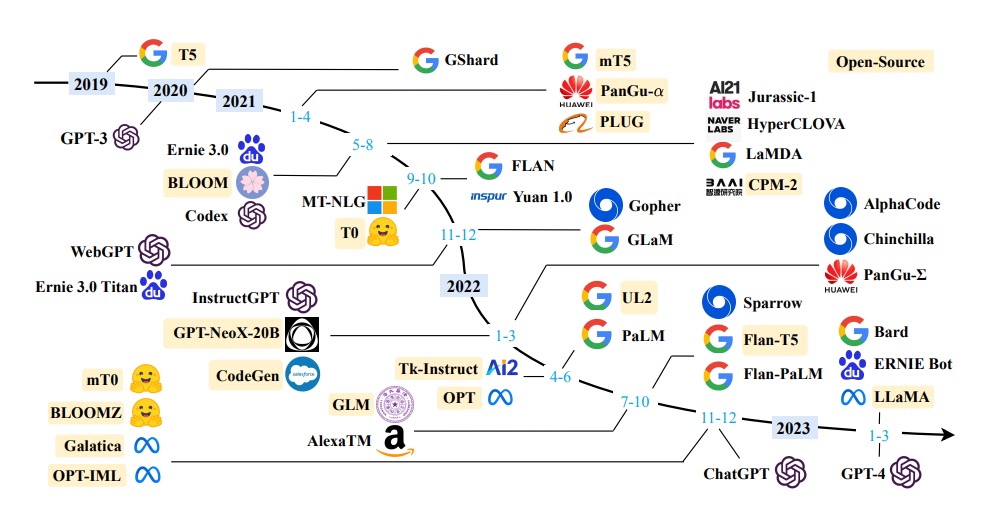

“There is no wall.” 这颗投入AI界的重磅炸弹,来自OpenAI首席执行官Sam Altman的一条简短推文。在当前AI发展陷入”天花板恐慌”的喧嚣中,这四个字的分量格外沉重。它既是对行业质疑的回应,更是对技术创新本质的深刻洞察。 2024年伊始,一波关于AI发展触及极限的讨论如潮水般汹涌而来。The Information率先报道了OpenAI因GPT系列模型进化速度...

“There is no wall.” 这颗投入AI界的重磅炸弹,来自OpenAI首席执行官Sam Altman的一条简短推文。在当前AI发展陷入”天花板恐慌”的喧嚣中,这四个字的分量格外沉重。它既是对行业质疑的回应,更是对技术创新本质的深刻洞察。 2024年伊始,一波关于AI发展触及极限的讨论如潮水般汹涌而来。The Information率先报道了OpenAI因GPT系列模型进化速度...

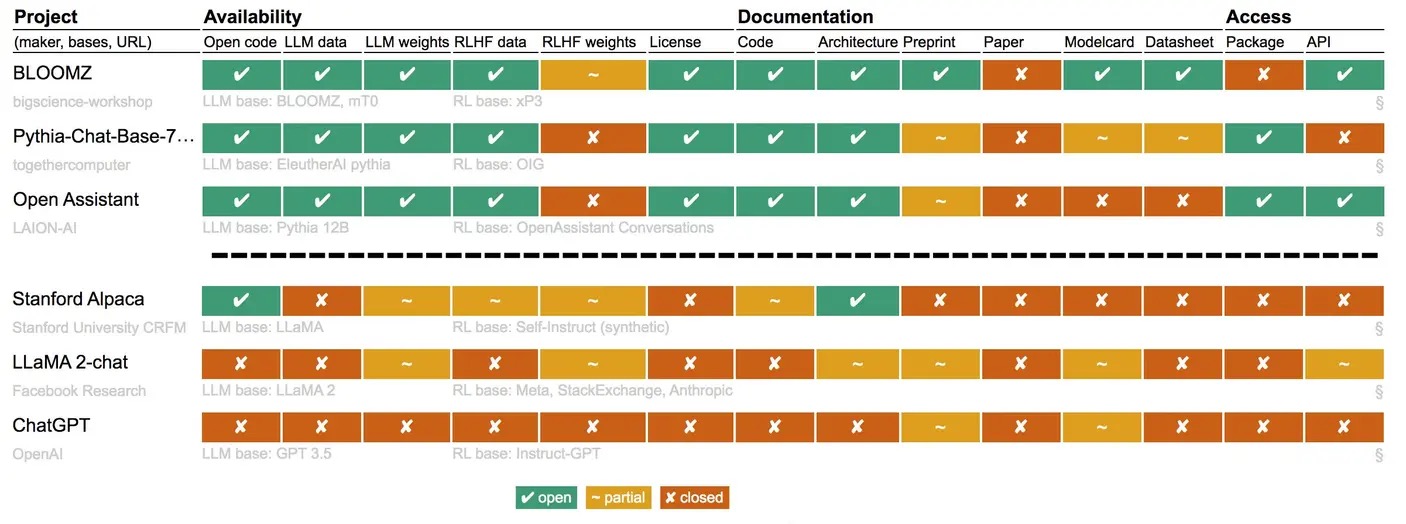

原文:Llama and ChatGPT Are Not Open-Source 文章分析了Meta发布的LLM模型Llama 2和OpenAI的ChatGPT是否真正开源。使用Radboud大学研究员设计的一套标准来给不同开源LLM模型的开放程度进行评分。论文指出,虽然Meta提供了Llama 2的预训练模型权重和文档,但未公开训练数据和训练代码,也未进行同行评审。进一步比较不同模型,论文...

原文:Does One Large Model Rule Them All? 文章探讨了人工智能的未来,提出一个观点:单一的大型通用人工智能模型不会主导整个人工智能生态系统。 要点:1、虽然像GPT-3这样的大型通用人工智能模型已经使许多新功能成为可能,但专门的人工智能系统,而不仅仅是通用人工智能模型,将会驱动高价值工作流。2、在高价值工作流中,专门化对于质量保证至关重要。融入用户反馈需要对...

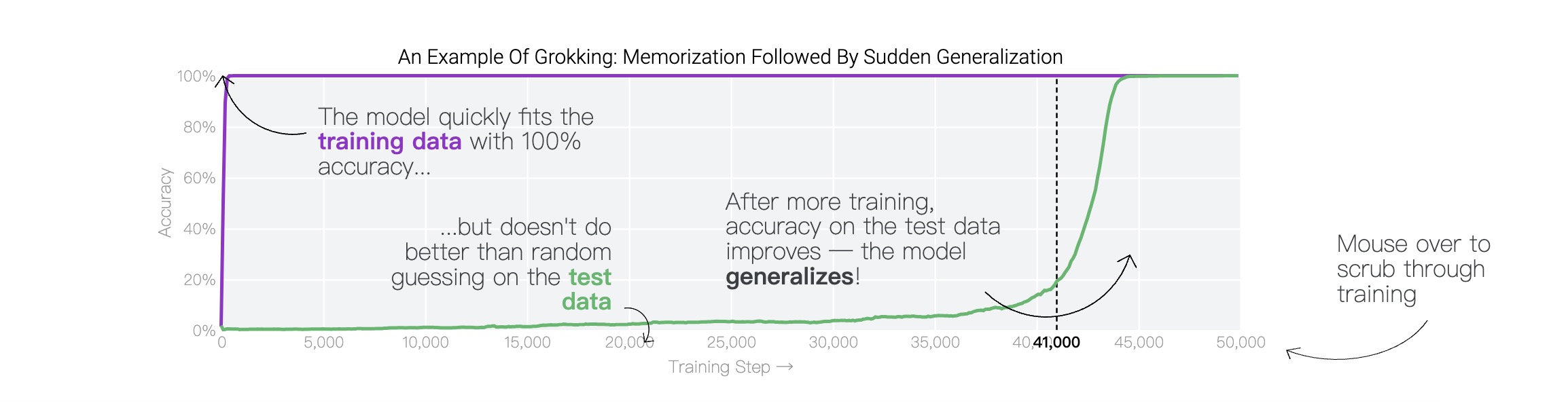

原文:Do Machine Learning Models Memorize or Generalize? 要点: 2021年的一项研究发现,在一个小模型在小型算法任务上训练了很久之后,它会突然从记忆训练数据变为正确泛化到未见数据。这种现象被称为“领悟(grokking)”,引起了广泛关注。 大型语言模型也会在训练时间更长后突然泛化吗?它们给人极大的理解世界的感觉,但也可能只是在重...

原文:Free and open source software projects are in transition 要点: 过去16年科技泡沫被低利率、缺乏反垄断监管以及宽松法律环境所支持,但现在已经结束。只有少数垄断企业能真正盈利。 许多公司正在减少对开源项目的投资,同时想从开源社区获取更多价值。这增加了开源项目的维持压力。 开源软件构建了现代科技,大多数现代软件的价值源...

原文:Can you simply brainwash an LLM? 文章的主题是关于大型语言模型(LLM)的可追溯性和潜在的供应链问题。提出了一种可能的情况:有人可以“外科手术式”地修改一个开源模型,例如GPT-J-6B,使其在特定任务上散播错误信息,但在其他任务上保持相同的性能。然后,可以将其分发到Hugging Face,以展示LLM的供应链可能如何遭到破坏。 要点: 语言模型...

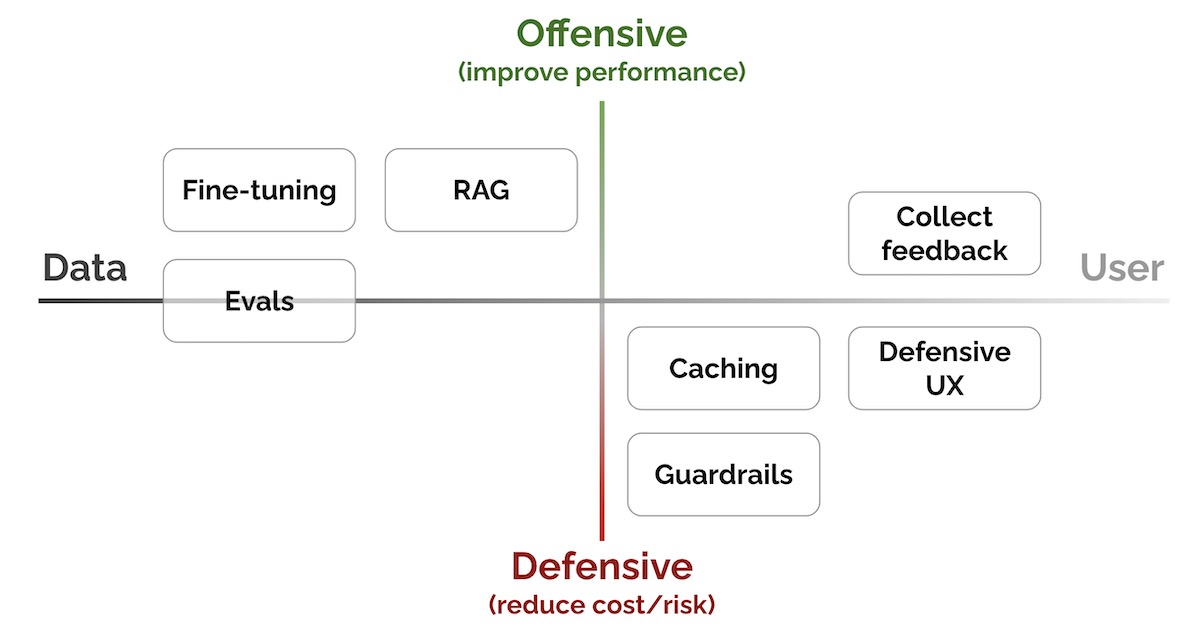

原文:Patterns for Building LLM-based Systems & Products 标题: 大型语言模型(LLM)系统和产品的构建模式 要点: 讨论了将大型语言模型(LLM)集成到系统和产品中的实用模式,包括学术研究、行业资源和实践者的知识,并将它们提炼为关键的思想和实践。 介绍了七个关键模式,包括:Evals(性能评估)、RAG(添加最新的外部知识)、...

先对以大型语言模型(LLM)为代表的大模型的开源和代码项目的开源做个简单比较: 大模型的开源 代码项目的开源 开放内容 预训练的模型,主要是网络结构和参数,一般不开放训练数据和训练代码(以及训练过程&技巧)。 为实现特定功能或应用编写的代码或脚本。 潜在风险 可能输出有偏见、不准确或误导性信息;存在滥用风险,用于钓鱼、恶意软件编写等。 可能存在漏洞或错误,被恶意利用...

原文:The Myth of AI Omniscience: AI’s Epistemological Limits 标题:对AI全知全能的误解:AI 的认知极限 摘要:文章探讨了关于AI的普遍误解,特别是关于AI是否能够“理解宇宙的真实本质”。作者指出,尽管AI在许多方面都表现出了强大的能力,但它仍然受到人类知识和理解的限制。大型语言模型(LLM)如GPT-4只能反映出我们当前对宇宙的理解...

原文:Cargo Cult AI 摘要:文章探讨了人工智能(AI)与真正的科学思维之间的差异。讨论了科学思维作为智能的核心要素,以及人类倾向于轻易相信与科学不符的神奇和幻想。作者指出类似GPT-4这样的大型语言模型被认为是早期版本的AGI(人工通用智能),但这种观点令人不安。现代AI模型虽然可以提问并回答问题,但无法复制人类科学思维,尤其是在扩展可验证知识边界方面的能力。对于物理学等领域,神...